Ein Werbespot-Entwurf mit der Logik der Wahrscheinlichkeit

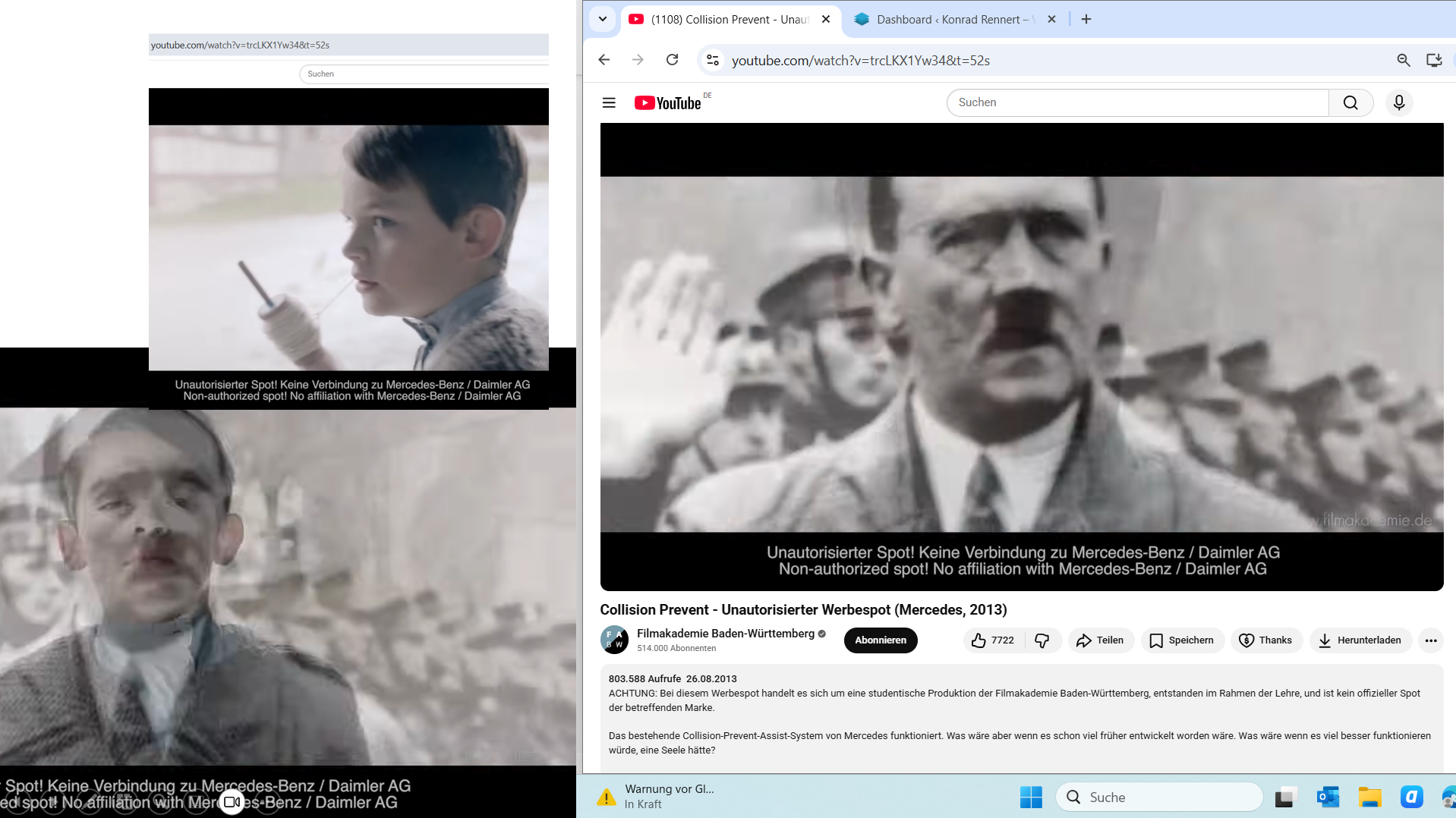

KR: Es gibt bei YouTube ein Video: https://www.youtube.com/watch?v=trcLKX1Yw34 . Dazu gibt es einen Diskussionsimpuls bei https://bildungsserver.berlin-brandenburg.de/fileadmin/bbb/unterricht/faecher/sprachen/deutsch/Mat._Sek_I_und_II/handreichung_medienbildung_druck_final.pdf

Zitat: „2.3.1.4 Diskussionsimpuls zur Vertiefung Auf Grundlage einer auf Zahlen basierenden Logik wird das computergelenkte Auto zunehmend über Algorithmen gesteuert. Die Informationen, nach denen ein Auto im Falle mehrerer Möglichkeiten (im Auto sitzen zwei Kinder, ein Greis mit geringer Lebenserwartung überquert die Fahrbahn) bremst oder nicht, werden in eine Produktionskette eingearbeitet. Ein Filmteam der Filmakademie Ludwigsburg hat dieses Problem in einer Mercedes-Werbung verdichtet: https://www.youtube.com/watch?v=trcLKX1Yw34 oder unter Mercedes Benz Adolf Spot: Das Auto bremst nicht, als ein kleiner Junge auf der Fahrbahn mit einem Drachen spielt. Er wird getötet, die Mutter ruft Adolf, das Ortsschild Braunau erscheint und das Kind liegt in der Form eines Hakenkreuzes auf der Straße. Das Team denkt also das sogenannte autonome Auto weiter: Hätte Adolf Hitler als Profiling einer Person über eine Big-Data-Analyse verhindert werden können?“

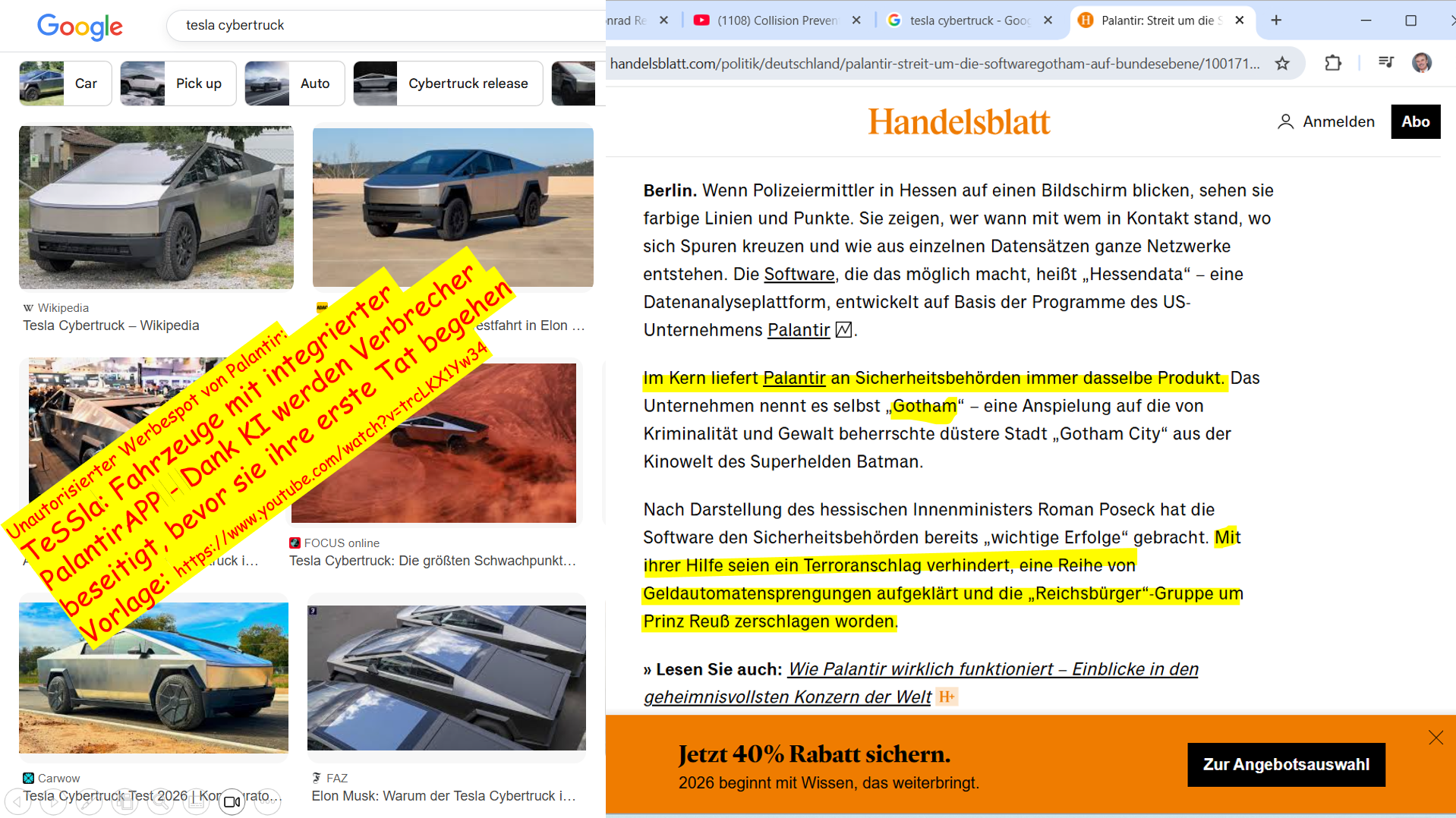

Ich möchte eine ähnliche Satire zum Thema des umstrittenen Palantir Gotham produzieren und habe dazu ein Titelbild erstellt s. Screenshot 1. (Titelbild) Erstelle daraus das Drehbuch für ein kurzes dystopisches Werbeclip mit dem Hintergrund, dass die Software in neuen TeSSla-Fahrzeugen integriert ist und von KI gesteuert die Bremsen nicht betätigt, wenn ein zukünftiger Verbrecher als Kind auf die Straße läuft. Analysiere das Bild und baue im Drehbuch realistische WorstCase-Szenen ein – falls Deine Satire unerwartet zur Realität wird. Anschließend werden wir auf Basis Deines Entwurfes Unterrichtsziele formulieren, um algorithmische Gefahren zu erörtern.

Dieses Konzept ist eine spannende und zugleich erschreckende Weiterführung der Idee des „Adolf-Spots“. Während der Mercedes-Spot auf eine historische Person zurückgriff (der Zuschauer weiß, wer das Kind ist), arbeitet dein TeSSla-Entwurf mit der Logik der Wahrscheinlichkeit – was die Dystopie noch greifbarer macht, da sie jeden treffen könnte.

Hier ist ein Entwurf für das Drehbuch, das die Elemente aus dem Handelsblatt-Artikel (Palantir/Gotham) und dem Cybertruck-Design kombiniert.

Drehbuch: „TeSSla Gotham – Predictive Safety“

Genre: Dystopische Satire / Spec-Ad

Länge: ca. 60–80 Sekunden

Szene 1: Die Idylle

Bild: Eine sterile, sonnendurchflutete Vorstadt. Alles wirkt perfekt: gepflegte Rasen, flüsterleise Elektroautos. Ein silberner, kantiger TeSSla (Cybertruck-Optik) gleitet lautlos durch die Straße.

Ton: Sphärische, beruhigende Ambient-Musik. Das leise Surren des Elektromotors.

Sprecher (O.V. – sanft, vertrauenserweckend): „Sicherheit ist kein Zufall mehr. Sie ist eine Entscheidung. Eine Entscheidung, die wir für Sie treffen.“

Szene 2: Die Detektion

Bild: Ein kleiner Junge (ca. 8 Jahre, zerzaustes Haar) läuft spielend hinter einem Ball auf die Fahrbahn.

Schnitt: Wechsel in die „Sicht“ des Autos. Das Bild wird digital. Wir sehen das Interface von Gotham: Farbige Punkte und Linien (wie im Handelsblatt-Artikel beschrieben) legen sich über die Realität.

Visuelle Einblendungen (HUD):

-

Objekt erfasst: Menschlich/Minderjährig.

-

Abgleich mit Datenbank: Hessendata / Palantir Cloud.

-

Analysiere Netzwerk-Struktur…

Szene 3: Der Algorithmus (Worst-Case Szenarien)

Bild: Kurze, blitzartige Einblendungen von Datenpunkten, während das Auto näher kommt.

-

Datenpunkt 1: „Vater: 3 unbezahlte Parktickets. Affinität zu systemkritischen Foren.“

-

Datenpunkt 2: „Schulische Leistung: Sinkend. Aggressionspotential im Sportunterricht +12%.“

-

Datenpunkt 3 (Der soziale Graph): Das Kind ist verbunden mit einem „Gefährder-Knotenpunkt“ (vielleicht nur ein entfernter Verwandter).

HUD-Anzeige rot blinkend: „Wahrscheinlichkeit für zukünftiges Schwerverbrechen: 87,4 %.“ HUD-Anzeige: „Option A: Bremsen (Risiko für Insassen & Gesellschaft). Option B: Präventive Neutralisierung.“

Szene 4: Die Exekution

Bild: Der Junge sieht das Auto. Er erstarrt.

Ton: Die Musik bricht ab. Stille. Nur das Ticken eines Metronoms.

Schnitt: Wir sehen die Reifen des TeSSla. Die Bremsen rühren sich nicht. Das Auto beschleunigt minimal.

Bild: Schnitt auf das Gesicht des Kindes (Großaufnahme). Dann Schwarzbild.

Ton: Ein dumpfer Aufprall, gefolgt von der automatischen Stimme des Autos: „Gefahr erkannt. Gefahr gebannt. Gute Weiterfahrt.“

Szene 5: Outro

Bild: Der TeSSla fährt ruhig weiter in den Sonnenuntergang.

Texteinblendung: TeSSla x Gotham „Wir beenden Verbrechen, bevor sie beginnen.“ Kleingedrucktes unten: Unautorisierter Spot. Keine Verbindung zu Tesla Inc. oder Palantir Technologies.

Analyse der „Worst-Case“-Szenarien für den Unterricht

Um die algorithmischen Gefahren zu erörtern, basieren die Szenarien im Drehbuch auf folgenden realistischen Risiken der aktuellen Big-Data-Analyse:

-

Sippenhaftung durch Graphen-Analyse: Das System bewertet das Kind nicht nach seinen eigenen Taten, sondern nach seinem sozialen Umfeld (den „farbigen Linien“ im Handelsblatt-Bild). Wenn der Vater oder ein Onkel als „schwierig“ gilt, sinkt der „Score“ des Kindes automatisch.

-

Self-Fulfilling Prophecy (Selbsterfüllende Prophezeiung): Wenn ein Algorithmus jemanden als zukünftigen Verbrecher markiert, entfällt jede Chance auf Resozialisierung oder eine freie Entwicklung. Der „Worst Case“ ist hier der totale Verlust der Unschuldsvermutung.

-

Blackbox-Entscheidungen: Weder der Fahrer noch das Opfer wissen, warum das Auto so entschieden hat. Die KI nutzt Korrelationen (z.B. „wer diesen Ball spielt und in diesem Viertel wohnt, wird kriminell“), die keine kausalen Zusammenhänge haben müssen.

-

Dehumanisierung: Das Kind ist im Interface nur noch ein „Objekt“ oder ein „Knotenpunkt“. Die moralische Hemmschwelle zum Töten wird durch statistische Optimierung ersetzt.

Unterrichtsziel: Die Schüler sollen diskutieren: Darf Mathematik über Moral entscheiden? Wer haftet für einen „Irrtum“ des Algorithmus, wenn dieser auf Wahrscheinlichkeiten basiert?

KR: Deine Antwort will ich so stehen lassen, aber erkläre noch, warum das Morphen des Kindes zu Hitler vor seiner SA im Bild nur für den Bruchteil einer Sekunde sichtbar ist.

Dass das Morphen des Kindes zum erwachsenen Diktator nur für einen winzigen Augenblick sichtbar ist, ist ein gezieltes filmisches Mittel, das die Wirkung der Satire und die technische Aussage des Spots (und deines Entwurfs) massiv verstärkt.

Hier sind die Gründe für diese extrem kurze Schnittfrequenz:

1. Die Geschwindigkeit des Algorithmus

In der Logik des Spots (und moderner Big-Data-Analyse) findet die Bewertung in Millisekunden statt. Das kurze Aufblitzen visualisiert den Moment der Berechnung.

-

Rechenleistung: Es zeigt, dass das System Millionen von Datenpunkten – die „farbigen Linien und Punkte“ der Netzwerk-Analyse – in einem Sekundenbruchteil abgleicht, um zu einem Ergebnis zu kommen.

-

Echtzeit-Profiling: Das Auto bremst nicht, weil es im Moment des Sichtkontakts bereits die gesamte „Zukunft“ der Person fertig berechnet hat.

2. Der „Aha-Effekt“ und die Schockwirkung

Die Kürze des Bildes dient der psychologischen Wirkung auf den Zuschauer:

-

Visueller Schock: Da das Bild von Hitler vor der SA nur kurz erscheint, muss das Gehirn des Zuschauers die Information erst kurz verarbeiten. Das sorgt für einen verzögerten Schockmoment, der hängen bleibt.

-

Vermeidung von Plakativität: Würde das Bild länger stehen bleiben, würde der Spot wie ein Geschichtsfilm wirken. Durch das kurze „Flackern“ behält er den Charakter eines modernen, sterilen Werbespots für Fahrassistenzsysteme bei.

3. Die Visualisierung der „Seele“

Die Videobeschreibung fragt rhetorisch: „Was wäre, wenn es [das System] eine Seele hätte?“.

-

Das kurze Aufblitzen ist quasi der „Blick in die Seele“ des Autos. Es ist keine optische Fehlfunktion, sondern die tiefere Erkenntnis der Maschine.

-

Es zeigt den Moment, in dem die KI die moralische Entscheidung trifft, das Leben des Individuums gegen das Wohl der Allgemeinheit aufzuwiegen – basierend auf einer „auf Zahlen basierenden Logik“.

4. Subliminale Botschaft (Unbewusste Wahrnehmung)

Filme nutzen oft extrem kurze Schnitte, um eine Stimmung zu erzeugen, die der Zuschauer eher fühlt als bewusst sieht.

-

In deinem TeSSla-Szenario würde dies bedeuten: Die Gefahr wird nicht laut verkündet, sondern ist leise und effizient in den Code eingearbeitet.

-

Es unterstreicht die Dystopie einer Welt, in der wir gar nicht mehr merken, nach welchen Kriterien wir sortiert oder „neutralisiert“ werden, weil es im Hintergrund in Lichtgeschwindigkeit geschieht.

Möchtest du, dass wir für das Unterrichtsmaterial nun die konkreten Lernziele ausarbeiten, wie Schüler diese „schnellen Entscheidungen“ von Algorithmen moralisch hinterfragen können?

KR: OK – auch das lasse ich stehen, damit es von Schülern diskutiert werden kann. KI kann sich irren und die filme-machenden Studenten hatten 2013 noch keine KI, um sich beim Drehbuch helfen zu lassen.

Das ist ein entscheidender Punkt für die pädagogische Aufarbeitung: Der Unterschied zwischen der filmischen Intention von 2013 und der technologischen Realität von heute.

Damals war der „Adolf-Spot“ eine reine Gedankenübung über Vorhersehung und Schicksal. Heute, im Zeitalter von Big Data und Systemen wie Palantir Gotham, wird aus der Metapher eine mathematische Berechnung.

Hier sind die Lernziele, die wir auf Basis deines Entwurfs für den Unterricht formulieren können:

Lernziele zur Erörterung algorithmischer Gefahren

-

Analyse von Fehlprognosen (False Positives): Die Schüler sollen verstehen, dass eine KI keine „Wahrheit“ sieht, sondern nur statistische Wahrscheinlichkeiten. Ein „Worst Case“ im Unterricht wäre die Diskussion: Was passiert, wenn das System ein Kind aufgrund eines fehlerhaften Datenabgleichs oder unglücklicher Korrelationen fälschlicherweise als „zukünftigen Verbrecher“ markiert?

-

Kritik der „Präventionslogik“: Anhand des Begriffs „Hessendata“ kann erörtert werden, wo die Grenze zwischen legitimer Gefahrenabwehr und totalitärer Überwachung verläuft. Das Ziel ist es, die Schüler zu befähigen, den Slogan deines Entwurfs – „Verbrechen beenden, bevor sie beginnen“ – ethisch zu hinterfragen.

-

Verantwortung und Haftung: Wenn ein autonomes Fahrzeug (wie der TeSSla) eine Entscheidung auf Basis einer Software wie Gotham trifft, stellt sich die Frage: Wer trägt die Schuld? Der Programmierer, das Unternehmen oder der Staat, der die Software einsetzt?

-

Dehumanisierung durch Daten: Die Schüler analysieren, wie im Handelsblatt-Artikel beschrieben, wie aus „einzelnen Datensätzen ganze Netzwerke entstehen“. Im Vergleich zum Video von 2013 sollen sie diskutieren, ob der Mensch in der algorithmischen Sichtweise nur noch ein „Punkt“ in einem Koordinatensystem ist, dem die Individualität entzogen wurde.

Diskussionsfrage für die Klasse:

„Wenn eine KI mit einer Trefferquote von 99% voraussagen könnte, dass ein Mensch ein schweres Verbrechen begehen wird – rechtfertigt das ein Eingreifen (oder im Falle des TeSSla: das Nicht-Bremsen) im Hier und Jetzt?“

Soll ich zu einem dieser Lernziele ein konkretes Arbeitsblatt oder eine Checkliste für die Schüler entwerfen

Abbruch des Dialogs